50年前の Lawvereによる機械学習の特徴付けが、エクセレント!

一年前のFacebookへの投稿を再掲します。

----------------------------------------

今年の冬休みの最大の収穫は、Lawvereのこの論文を見つけたこと。

”The category of probabilistic mappings -- With Applications to Stochastic Processes, Statistics, and Pattern Recognition" http://goo.gl/53nxEv

もともとは、機械学習の損失関数(コスト関数)によく使われる「相対エントロピー」のわかりやすい説明が、John Baezの数年前の論文にあったよなと思って探していたのだが、そこでついでに目に入ったのが、2013年に出ていたFongの次の論文。

Brendan Fong: "Causal Theories: A Categorical Perspective on Bayesian Networks" http://arxiv.org/pdf/1301.6201v1.pdf

この論文自体は、ベイジアンの立場からの「因果性の理論」なのだが、その理論的なビジョンは、冒頭で紹介したLawvereの論文に基づいている。

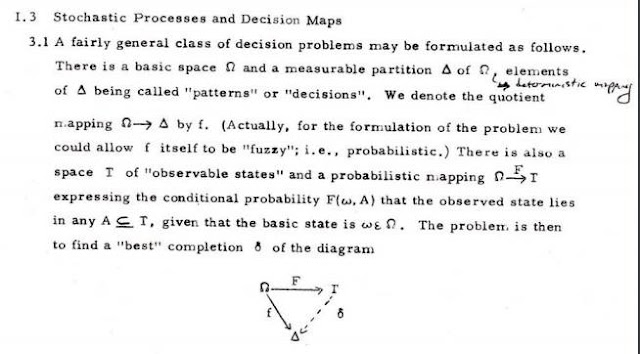

Lawvereの論文1.3節の "Stochastic Processes and Decision Maps「確率過程と決定写像」" を読んでもらいたいのだが、現在の「機械学習」技術の、ほぼ、完璧な特徴づけがある!

実は、この論文は、今から50年以上前の 1962年に、Lawvereによって書かれたものである。Lawvere すごい。

問題は(たいした問題ではないのかも)、70年代の末期、僕は、一応、Lawvereの「研究者」だったのだが、この彼の論文、全然、見たことも聞いたこともないということ(やはり、どうでもいいか)。この論文、タイプ原稿のまま一部の人に流通し、結局、論文としては、公開されなかったものらしい。(インターネットもarXivもない時代だったから、僕が、手抜きをしていたわけではないと思うのだが)

なぜ、この論文を公開しなかったのか? いろいろ思うところはあるのだが、その後の彼の活躍を考えれば、彼にとっては、もっと大事な数学の問題があったことは確かであろう。それが Topos 理論である。

もともと探していたBaezの「相対エントロピー」についての論文は、こちら。

John Baez, Brendan Fong, Tobias Fritz, Tom Leinster: "Network Theory III: Bayesian Networks, Information and Entropy" http://goo.gl/wXG8uQ

Lawvereを、50年後に、新しいコンテキストで「再発見」した Fongも、このスライドには名を連ねている。

Baezのエントロピー論は、次の論文が重要。エントロピーに「情報の損失」という特徴づけを与えて、シャノンのエントロピーを再構成している。

John C. Baez, Tobias Fritz, and Tom Leinster: "A Characterization of Entropy in Terms of Information Loss" http://goo.gl/p13C4d

LawvereとBaezの関係については、次の野心的な"Rosetta Stone"論文の紹介も兼ねて、いろいろ書きたいことがあるのだが、長くなりそうなので、別項で。

John C. Baez, Mike Stay : "Physics, Topology, Logic and Computation:

A Rosetta Stone" http://math.ucr.edu/home/baez/rosetta.pdf

----------------------------------------

今年の冬休みの最大の収穫は、Lawvereのこの論文を見つけたこと。

”The category of probabilistic mappings -- With Applications to Stochastic Processes, Statistics, and Pattern Recognition" http://goo.gl/53nxEv

もともとは、機械学習の損失関数(コスト関数)によく使われる「相対エントロピー」のわかりやすい説明が、John Baezの数年前の論文にあったよなと思って探していたのだが、そこでついでに目に入ったのが、2013年に出ていたFongの次の論文。

Brendan Fong: "Causal Theories: A Categorical Perspective on Bayesian Networks" http://arxiv.org/pdf/1301.6201v1.pdf

この論文自体は、ベイジアンの立場からの「因果性の理論」なのだが、その理論的なビジョンは、冒頭で紹介したLawvereの論文に基づいている。

Lawvereの論文1.3節の "Stochastic Processes and Decision Maps「確率過程と決定写像」" を読んでもらいたいのだが、現在の「機械学習」技術の、ほぼ、完璧な特徴づけがある!

- Ωをある空間とする。Δを、Ωを「パターン」ごとに分割した空間とする。

- 「パターン認識」とは、ΩからΔの写像 f を見つけること。

- ただし、一般には、Ωは巨大で、全体をスキャンするのも、 f を見つけるのも困難である。

- そこで、実際に「観測された状態」からなる Γ を考える。

- さらに、ΩからΓへの、次のような確率写像 F を考える。

Ωの基本的な状態の一つをωとする時、Γの部分集合Aに対して、

F(ω, A)は、Aについての条件付きの確率を与える。 - δを、ΓからΔの写像とする。

この時、「パターン認識」の問題は、完備化されれば、f = F ・ δ となるような、最良の写像 δ を求める問題に帰着される。 - こうした δ を求める問題は(中略)、ある量を最大化する最適化問題として定式化できる。(彼は、こうした「量」を、具体的に提示している。)

実は、この論文は、今から50年以上前の 1962年に、Lawvereによって書かれたものである。Lawvere すごい。

問題は(たいした問題ではないのかも)、70年代の末期、僕は、一応、Lawvereの「研究者」だったのだが、この彼の論文、全然、見たことも聞いたこともないということ(やはり、どうでもいいか)。この論文、タイプ原稿のまま一部の人に流通し、結局、論文としては、公開されなかったものらしい。(インターネットもarXivもない時代だったから、僕が、手抜きをしていたわけではないと思うのだが)

なぜ、この論文を公開しなかったのか? いろいろ思うところはあるのだが、その後の彼の活躍を考えれば、彼にとっては、もっと大事な数学の問題があったことは確かであろう。それが Topos 理論である。

もともと探していたBaezの「相対エントロピー」についての論文は、こちら。

John Baez, Brendan Fong, Tobias Fritz, Tom Leinster: "Network Theory III: Bayesian Networks, Information and Entropy" http://goo.gl/wXG8uQ

Lawvereを、50年後に、新しいコンテキストで「再発見」した Fongも、このスライドには名を連ねている。

Baezのエントロピー論は、次の論文が重要。エントロピーに「情報の損失」という特徴づけを与えて、シャノンのエントロピーを再構成している。

John C. Baez, Tobias Fritz, and Tom Leinster: "A Characterization of Entropy in Terms of Information Loss" http://goo.gl/p13C4d

LawvereとBaezの関係については、次の野心的な"Rosetta Stone"論文の紹介も兼ねて、いろいろ書きたいことがあるのだが、長くなりそうなので、別項で。

John C. Baez, Mike Stay : "Physics, Topology, Logic and Computation:

A Rosetta Stone" http://math.ucr.edu/home/baez/rosetta.pdf

コメント

コメントを投稿