Back to the Future -- RNNの復活

RNNは、その"Sequence to Sequence"の能力を生かして、現在は、Deep Learningの主役の一人に返り咲いている。では、前回のポストで見たRNNの抱えていた困難は、どのように克服されたのであろうか? ここでは、そのことを詳しく述べることはできない。

ただ、RNNの復活に大きな役割を果たしたのは、皮肉なことに、RNNの抱えている困難を原理的に明らかにし、いわば、かつてRNNに「引導」を渡した二人、Hochreiter とBengioであることに気づく。

それは、本当は、皮肉なことではないのかもしれない。問題の難しさを一番よく理解している人が、問題の解決に一番近いところにいるのは、ある意味自然なことであるのだから。

1997年に、Hochreiter と Schmidhuberが論文 "Long Short Term Memory "で導入したLSTMは、現在のRNN技術の中核となった。Googleの「ニューラル機械翻訳」もLSTMベースである。LSTMについては、次回以降のポストで、詳しく見てみたいと思う。

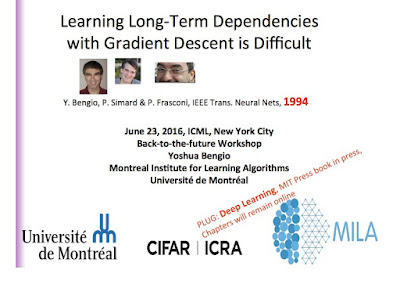

去年 2016年の6月のICML (International Conference on Machine Learning)で、Bengioが、面白いタイトルの講演をしている。タイトルは、"Learning Long-Term Dependencies with Gradient Descent is Difficult" 。そう、1994年に、彼がRNNの原理的な困難を明らかにした論文と同じタイトルである。

この講演のスライドはこちら 。ビデオはこちらである。

ただ、RNNの復活に大きな役割を果たしたのは、皮肉なことに、RNNの抱えている困難を原理的に明らかにし、いわば、かつてRNNに「引導」を渡した二人、Hochreiter とBengioであることに気づく。

それは、本当は、皮肉なことではないのかもしれない。問題の難しさを一番よく理解している人が、問題の解決に一番近いところにいるのは、ある意味自然なことであるのだから。

1997年に、Hochreiter と Schmidhuberが論文 "Long Short Term Memory "で導入したLSTMは、現在のRNN技術の中核となった。Googleの「ニューラル機械翻訳」もLSTMベースである。LSTMについては、次回以降のポストで、詳しく見てみたいと思う。

去年 2016年の6月のICML (International Conference on Machine Learning)で、Bengioが、面白いタイトルの講演をしている。タイトルは、"Learning Long-Term Dependencies with Gradient Descent is Difficult" 。そう、1994年に、彼がRNNの原理的な困難を明らかにした論文と同じタイトルである。

ポイントは、この講演が、このカンファレンスの "Neural Nets Back to the Future" というワークショップで行われていること。

このワークショップの目的は、次のようなものだ。(LSTMを使ったGoogle翻訳を使って見た。十分、下訳として使える!)

As research in deep learning is extremely active today, we could take a step back and examine its foundations. We propose to have a critical look at previous work on neural networks, and try to have a better understanding of the differences with today's work. Previous work can point at promising directions to follow, pitfalls to avoid, ideas and assumptions to revisit. Similarly, today's progress can allow a critical examination of what should still be investigated, what has been answered...

ディープ・ラーニングの研究が今日非常に活発なので、私たちは一歩踏み込んで基礎を調べることができました。私たちは、ニューラルネットワークに関する以前の研究を批判的に見て、今日の研究との違いをよりよく理解しようと提案します。これまでの作業は、有望な指示に従うこと、回避すべき落とし穴、アイディアや再考の前提を指すことができます。同様に、今日の進歩は、何がまだ調査されるべきか、何が答えられたのかの批判的検討を可能にすることができる... (Google 翻訳)

ディープ・ラーニングの研究が今日非常に活発なので、私たちは一歩踏み込んでその基礎を調べることができるでしょう。私たちは、ニューラルネットワークに関する過去の研究を批判的に見て、今日の研究との違いをよりよく理解しようと提案します。過去の取り組みは、従うべき有望な方向、回避すべき落とし穴、再考すべきアイディアや前提を、私たちに示すことができます。同様に、今日の進歩は、何が今後も研究されるべきか、何が解決されたのかを、批判的検討することを可能にします... (Google 翻訳を下訳に使った、丸山訳)こうした趣旨からいえば、1994年のBengioの論文は、取り上げられてしかるべきものの一つだろう。

この講演のスライドはこちら 。ビデオはこちらである。

コメント

コメントを投稿